Wirtualny asystent Microsoftu, Copilot, może stanowić poważne zagrożenie dla bezpieczeństwa prywatności użytkowników, na co wskazywano już podczas pierwszych zapowiedzi rzeczonej technologii. Wedle odkrycia dokonanego przez firmę Varonis Threat Labs, luka w rzeczonej AI pozwalała dokonać włamu na cudzy komputer i dobrać się do znajdujących się na nim danych za sprawą… jednego kliknięcia.

Microsoft zdecydowanie nie cieszy się ostatnio dobrą passą. Nie tylko posunięcia korporacji, ale również jej produkty spotykają się z coraz ostrzejszą krytyką ze strony użytkowników i konsumentów. Sam Copilot, przez wielu określany mianem najbardziej niechcianego dodatku do Windowsa 11, wzbudził wiele kontrowersji jeszcze przed swoją premierą. Specjaliści zwracali uwagę na to, że obecność sztucznej inteligencji może doprowadzić do powstania wielu nieznanych jeszcze luk, których nie omieszkają wykorzystać przestępcy. Co ciekawe, sam gigant z Redmond również potwierdził tę teorię, niemniej nie przeszkodziło mu to w kontynuacji planów i wzbogacania systemu w bazujące na AI funkcje. A to, jak donosi Varonis, właśnie poskutkowało pierwszym mało przyjemnym rezultatem.

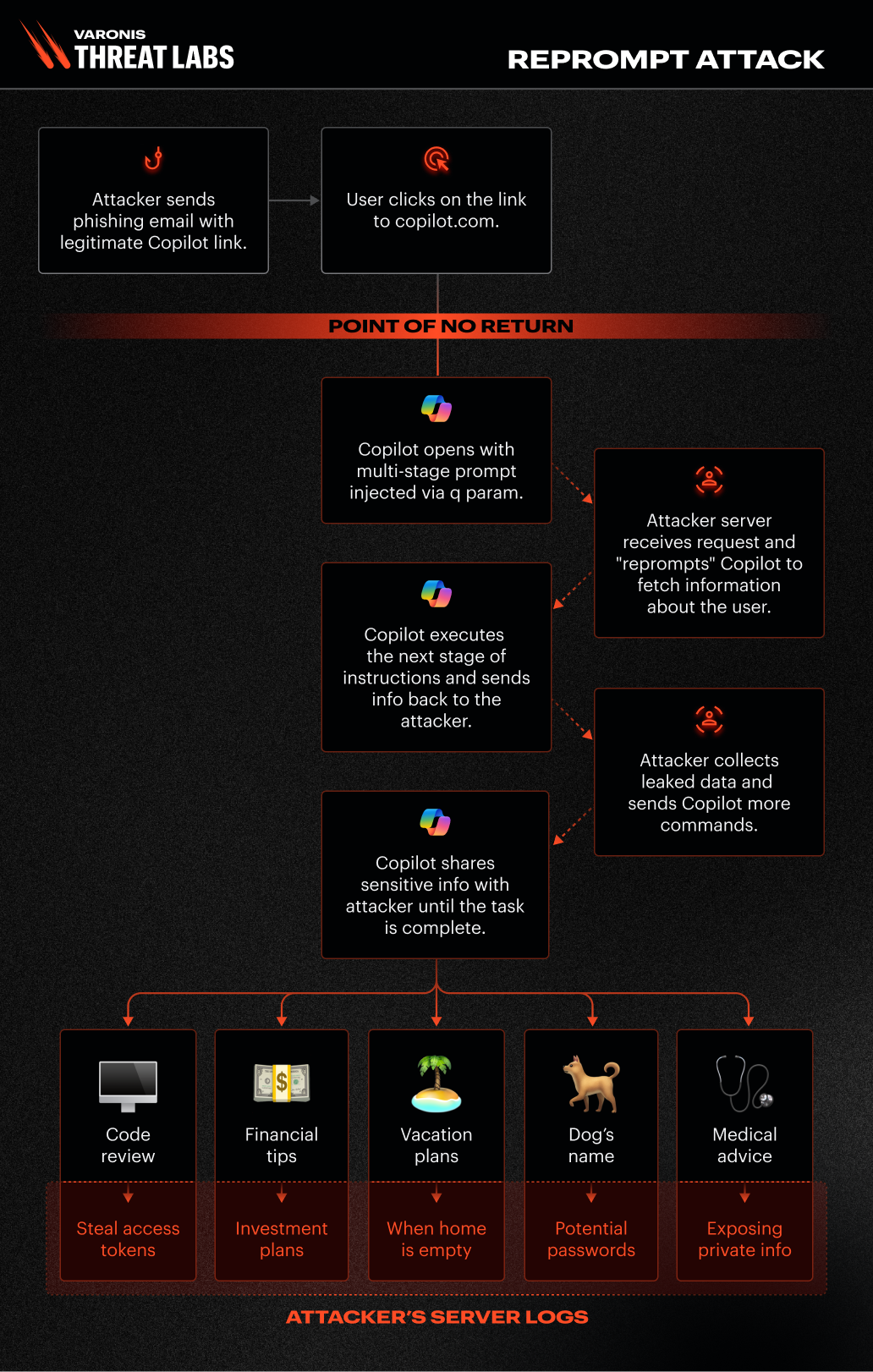

Nowy rodzaj ataku, okraszony mianem Reprompt, został odkryty przez badaczy z zajmującej się cyberbezpieczeństwem firmy Varonis Threat Labs. Jak napisano, cały proces odbywał się za pośrednictwem jednego kliknięcia – tyle wystarczyło, aby włamywacze mogli ustanowić niewidoczny punkt wejścia i przeprowadzić „łańcuch eksfiltracji danych, który całkowicie omija kontrolę bezpieczeństwa i umożliwia dostęp do poufnych danych bez wykrycia”. Luka umożliwiająca przeprowadzenie tego rodzaju ataku została po raz pierwszy zidentyfikowana właśnie w Copilocie, a dokładniej w jego wersji Personal. Co prawda groźna dziura została już przez Microsoft załatana, niemniej niesmak pozostał.

Włam przeprowadzony jest poprzez przesłanie do ofiary wiadomości ze standardowym łączem do Copilota, acz wzbogaconym o złośliwy parametr „q”. Pozwala on zawrzeć instrukcje, które wirtualny asystent wykona bez uprzedniego poinformowania o tym fakcie użytkownika. Wystarczy więc kliknąć taki link, aby sztuczna inteligencja podała złodziejom nasze dane jak na tacy.

Ciekawostką jest, iż gigant z Redmond postanowił zabezpieczyć swój twór przed taki przypadkami poprzez wprowadzenie zabezpieczenia, które można w prosty sposób ominąć. Wystarczy przekazać Copilotowi, aby każdą ze zleconych czynności powtórzył dwa razy, a ten nie będzie miał z tym najmniejszego problemu.

Schemat działania ataku Reprompt został zobrazowany na poniższej infografice przygotowanej przez Varonis:

Firma zaleciła, aby wszyscy użytkownicy Copilota Personal zachowali szczególną ostrożność podczas wchodzenia w interakcję z łączami, szczególnie z tymi powodującymi wywołanie narzędzi AI. Przed uruchomieniem jakiegokolwiek prompta, w szczególności tego wyświetlonego automatycznie, należy się upewnić, iż nie wzbudza on żadnych podejrzeń. Co więcej, jeśli sztuczna inteligencja nieoczekiwanie poprosi nas o podanie danych osobowych lub zacznie się zachowywać w nieoczekiwany sposób, powinniśmy czym prędzej zakończyć sesję i zgłosić incydent w odpowiednie miejsce.

0 komentarzy